L’UE émet un avertissement après qu’Elon Musk a retiré Twitter de l’accord de lutte contre la désinformation

Qu’est-ce que la désinformation ? Auparavant, il s’agissait d’informations véridiques que le ministère de la sécurité intérieure jugeait trompeuses. Aujourd’hui, elle a été redéfinie pour englober également la désinformation (fausse information). Mais il s’agit d’un concept glissant, car nous avons le droit, en vertu du premier amendement, à la liberté d’expression : nous pouvons dire ce que nous voulons. Il n’est pas nécessaire que ces propos soient exacts à 100 %. Et si ce discours a lieu à Washington, DC, vous pouvez être sûr qu’il n’est jamais exact à 100 %.

C’est en vertu de ce premier amendement que le comité de gouvernance de la désinformation du ministère de la sécurité intérieure, dirigé par Nina Jankowicz, qui se prend pour Mary Poppins, a été fermé l’année dernière.

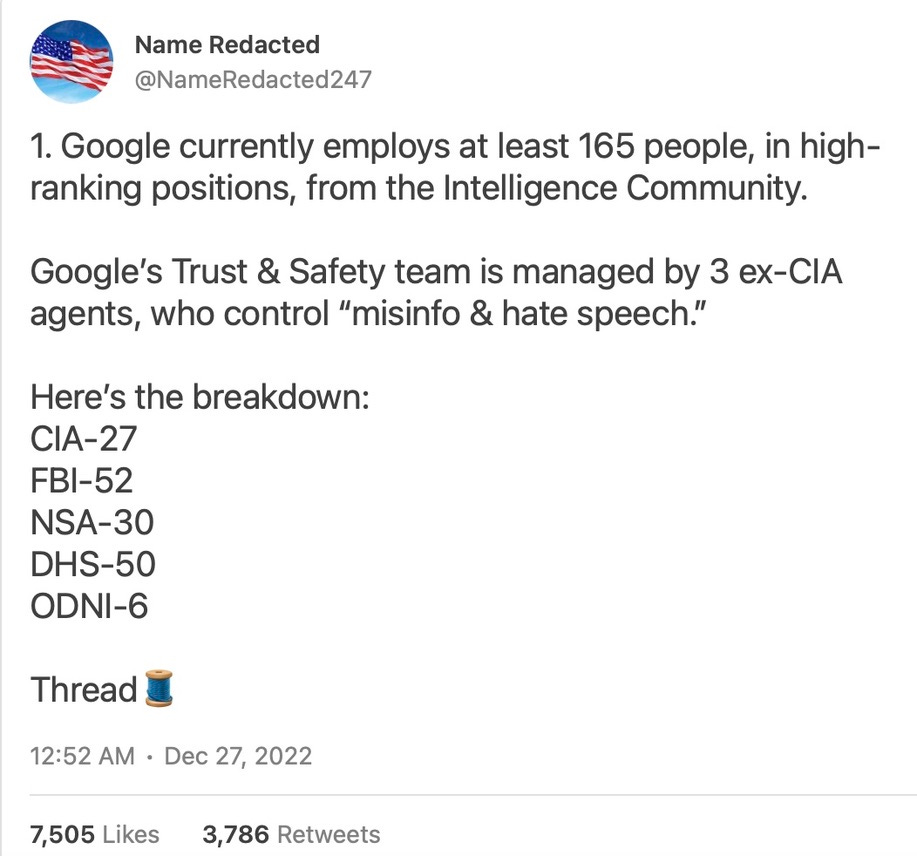

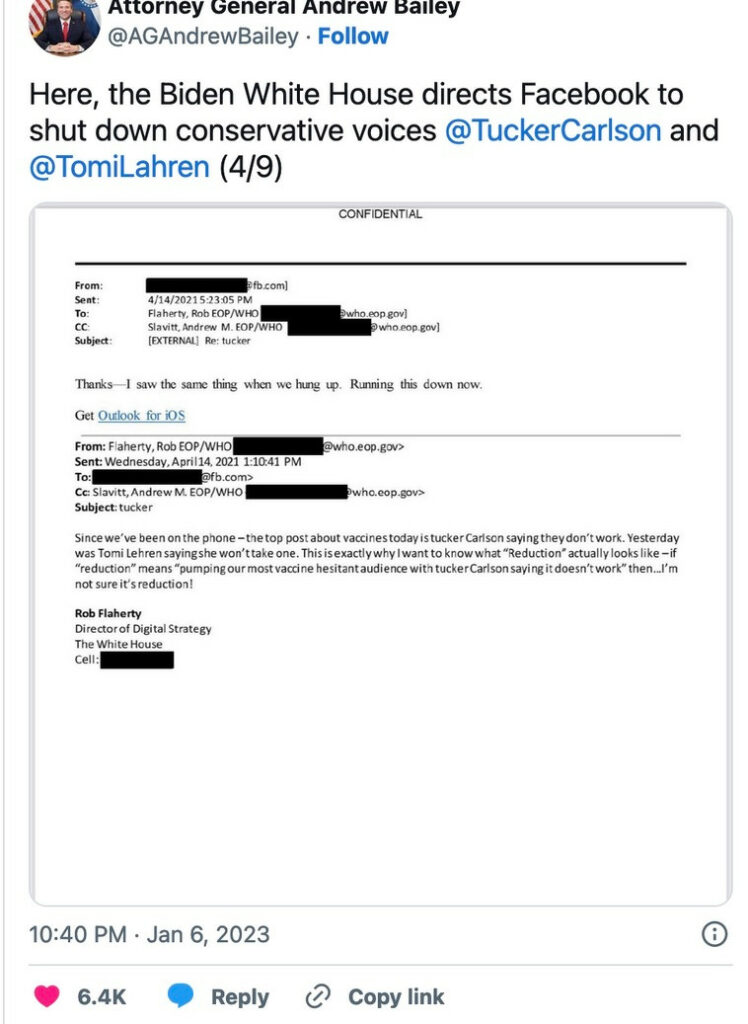

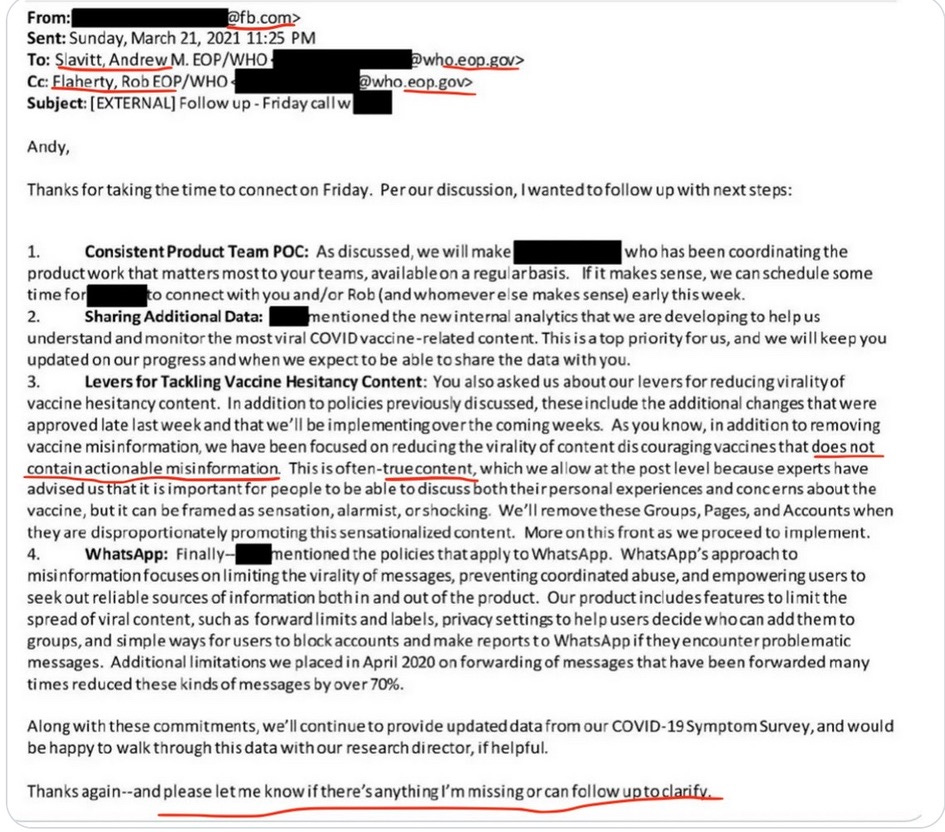

Il s’est avéré que le gouvernement des États Unis dirigeait une vaste opération de censure aux États-Unis (et dans le monde) impliquant au moins 12 agences fédérales et des dizaines d’organisations à but non lucratif, d’universités et d’entreprises à but lucratif, pour plusieurs milliards de dollars par an. J’en ai parlé lors de ma conférence à Stockholm en janvier et j’en ai également parlé ici.

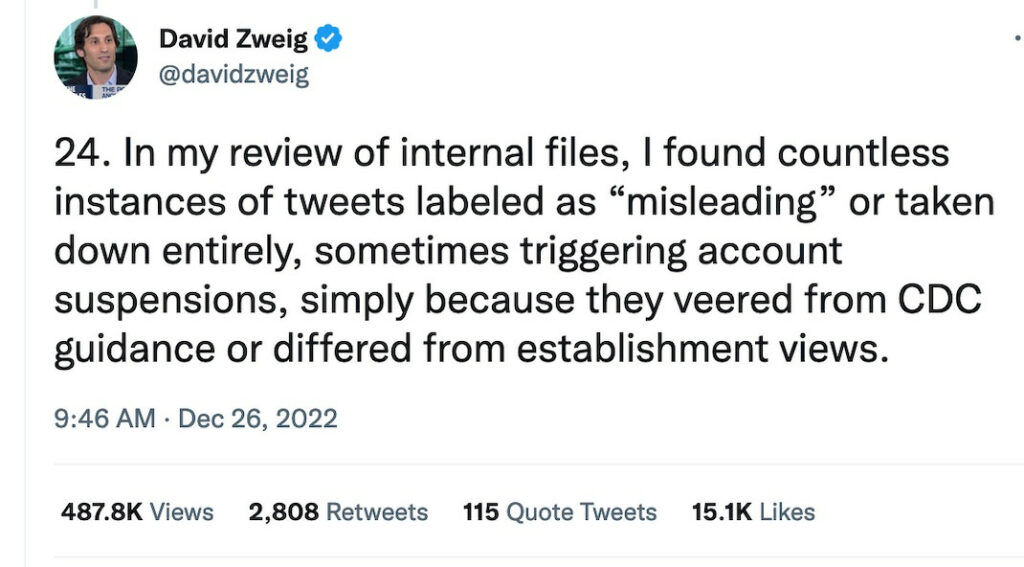

Vous trouverez ci-dessous quelques bribes d’informations importantes que j’ai conservées, ainsi qu’une histoire intéressante sur la façon dont le « commissaire au marché intérieur » de l’UE menace Elon Musk pour avoir affirmé que Twitter allait se retirer de la lutte contre la désinformation en Europe. Tiré des fichiers Twitter : OGA (other government agency) signifie CIA. Mon prochain texte contiendra les diapositives sur le contrôle de la désinformation et de la mésinformation que j’ai présentées lors de la conférence que j’ai donnée à Stockholm en janvier.

Mais les avocats chargés d’informer le Congrès sur la loi se sont montrés réticents.

https://www.theepochtimes.com/eu-issues-waring-after-elon-musk-pulls-twitter-out-of-anti-disinformation-agreement_5296657.html Par Jack Phillips

28 mai 2023 Mis à jour : 29 mai 2023

Les hauts fonctionnaires de l’Union européenne étaient furieux ce week-end après que le propriétaire de Twitter, Elon Musk, a retiré la plateforme de médias sociaux du « Code de bonnes pratiques » de l’Union européenne, qui, selon les critiques, équivaut à un régime de censure.

Le commissaire européen chargé du marché intérieur, Thierry Breton, a écrit que Twitter avait quitté le code de bonnes pratiques de l’Union, après que des rapports aient affirmé que la plateforme allait le faire. M. Breton a averti que Twitter serait confronté à certaines responsabilités juridiques.

« Twitter quitte le code de bonnes pratiques volontaire de l’UE contre la désinformation. Mais les obligations demeurent. Vous pouvez courir, mais vous ne pouvez pas vous cacher », a écrit M. Breton. « Au-delà des engagements volontaires, la lutte contre la désinformation sera une obligation légale en vertu de la #DSA (Digital Services Act) à partir du 25 août. Nos équipes seront prêtes pour l’application de la loi

Un fonctionnaire de l’UE a également déclaré à Euractiv que le bloc » attendait cela » et que » ce n’était qu’une question de temps » avant que des rapports ne fassent surface sur le retrait de Musk.

Les règles connues sous le nom de Digital Services Act (DSA) obligent les entreprises à gérer les risques, à mener des audits externes et indépendants, à partager des données avec les autorités et les chercheurs, et à adopter un code de conduite d’ici le mois d’août.

Parmi les 19 entreprises soumises à ces règles figurent Google Maps, Google Play, Google Search, Google Shopping d’Alphabet, YouTube, Facebook et Instagram de Meta, Marketplace d’Amazon, App Store d’Apple et Twitter. Les autres sont les deux unités de Microsoft, LinkedIn et Bing, booking.com, Pinterest, Snapchat de Snap Inc, TikTok, Wikipedia, Zalando et AliExpress d’Alibaba.

« Nous considérons que ces 19 plateformes en ligne et moteurs de recherche sont devenus systématiquement pertinents et ont des responsabilités particulières pour rendre l’internet plus sûr », a déclaré M. Breton à la presse plus tôt cette année, ajoutant que ces entreprises devraient cibler la désinformation.

M. Breton a déclaré qu’il vérifiait si quatre ou cinq autres entreprises relevaient du règlement DSA, et qu’une décision était attendue dans les prochaines semaines. M. Breton a critiqué le système de modération du contenu de Facebook en raison de son rôle dans la formation d’opinions sur des questions clés.

« Maintenant que Facebook a été désigné comme une très grande plateforme en ligne, Meta doit examiner attentivement le système et le corriger le plus rapidement possible si nécessaire », a-t-il déclaré, ajoutant : « Nous nous sommes également engagés à effectuer un test de résistance avec TikTok, qui a également exprimé son intérêt. J’attends donc avec impatience une invitation au siège de Bytedance pour mieux comprendre l’origine de Tiktok »

Twitter avait déjà accepté un test de résistance, et M. Breton a déclaré que lui et son équipe se rendraient au siège de l’entreprise à San Francisco à la fin du mois de juin de cette année pour effectuer l’exercice de simulation volontaire. M. Breton n’a pas précisé en quoi consisterait ce test.

Il existe des garde-fous pour les contenus générés par l’intelligence artificielle, tels que les vidéos « deep fake » et les images synthétiques, qui devront être clairement identifiés lorsqu’ils apparaîtront dans les résultats de recherche, a déclaré M. Breton. Il a également indiqué qu’en vertu de la loi sur les services numériques, les infractions pourraient être sanctionnées par de lourdes amendes pouvant aller jusqu’à 6 % du chiffre d’affaires annuel d’une entreprise.

Les plateformes devront « revoir complètement » leurs systèmes afin de garantir un niveau élevé de confidentialité et de sécurité pour les enfants, notamment en vérifiant l’âge des utilisateurs, a déclaré M. Breton.

Les grandes entreprises technologiques devront également réorganiser leurs systèmes pour « empêcher l’amplification algorithmique de la désinformation », a-t-il ajouté, se disant particulièrement préoccupé par les systèmes de modération de contenu de Facebook à l’approche des élections de septembre en Slovaquie.

La société mère de Facebook a déclaré qu’elle soutenait la nouvelle loi européenne sur les services numériques. « Nous prenons des mesures importantes pour lutter contre la diffusion de contenus préjudiciables sur Facebook et Instagram dans l’UE », a déclaré Meta il y a plusieurs semaines. « Bien que nous le fassions tout au long de l’année, nous reconnaissons que c’est particulièrement important pendant les élections et les périodes de crise, comme la guerre en cours en Ukraine. »

Critiques

Jacob Mchangama, historien danois, a tiré la sonnette d’alarme au sujet de la loi sur les services numériques à la fin de 2022, écrivant dans un article d’opinion que le plan serait un cas où le « remède » serait « pire que la maladie »

« Mais lorsqu’il s’agit de réglementer la liberté d’expression, les bonnes intentions n’aboutissent pas nécessairement à des résultats souhaitables », a-t-il écrit pour le Los Angeles Times. « En fait, il y a de fortes raisons de croire que la loi est un remède pire que le mal, susceptible d’entraîner de graves dommages collatéraux à la liberté d’expression dans toute l’UE et partout où les législateurs tenteront de l’imiter

Bien que « la suppression de contenus illégaux semble assez innocente », il écrit que « ce n’est pas le cas. » Ce terme – « contenu illégal » – est « défini de manière très différente en Europe », a-t-il déclaré. « En France, des manifestants ont été condamnés à des amendes pour avoir représenté le président Macron en Hitler, et les discours de haine illégaux peuvent englober l’humour offensant, tandis que l’Autriche et la Finlande criminalisent le blasphème

Un courriel de l’Epoch Times envoyé à Twitter pour obtenir des commentaires a été retourné avec une réponse automatisée qui comprenait un emoji caca. M. Musk avait annoncé en début d’année que l’emoji serait envoyé automatiquement lorsque les journalistes enverraient des demandes de commentaires.

Reuters et Associated Press ont contribué à ce rapport.

Publié à l’origine sur Meryl’s COVID Newsletter

Suggérer une correction